Коммутация SAN

SAN Коммутаторы (SAN switches)

SAN коммутаторы используются в качестве центрального коммутирующего устройства для узлов сети SAN. Вы вставляете один конец оптического кабеля в разъем на адаптере вашего сервера или контроллере дискового массива, а другой в порт на коммутаторе. Коммутатор можно сравнить с набором проводов, которые скроссированы таким образом, чтобы позволить каждому устройству сети «говорить» по одному проводу с любым другим устройством сети одновременно. Т.е, иными словами все абоненты могут разговаривать одновременно.

Один или несколько коммутаторов, соединенных между собой образуют фабрику. Одна фабрика может состоять из одного или нескольких коммутаторов (до 239 в настоящее время). Поэтому, фабрику можно определить как сеть, состоящую из соединенных между собой коммутаторов. SAN может состоять из нескольких фабрик. Большинство SAN состоит по крайне мере из двух фабрик, одна из которых является резервной.

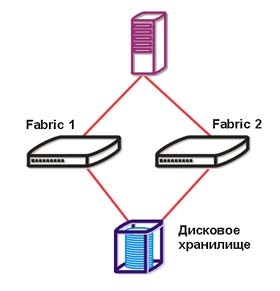

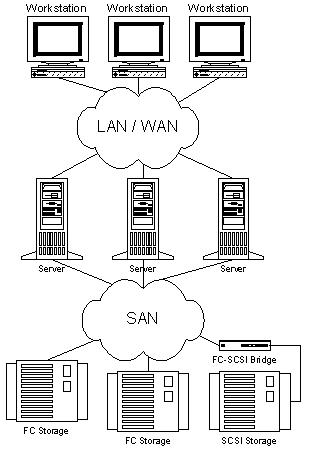

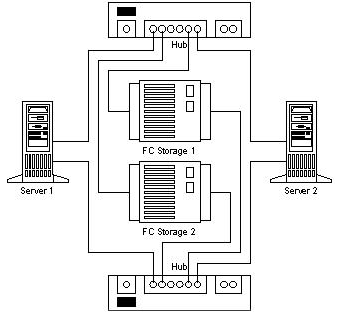

Вы можете подключить серверы и хранилища к SAN используя один коммутатор, но правилом хорошего тона является использование двух коммутаторов, дабы избежать потерю данных и простои при выходе из строя одного из них. На рисунке 1 показана обычная фабрика, использующая два коммутатора для соединения серверов с дисковым массивом.

Рис 1. Простейшая фабрика с использованием 2-х коммутаторов.

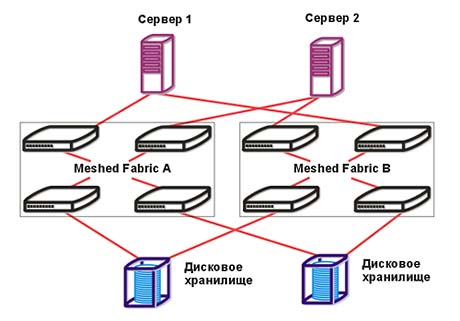

С увеличением количества серверов и хранилищ в вашей SAN вы просто добавляете коммутаторы.

Рис 2. Расширение SAN Fabric

Модульные или обычные коммутаторы (modular switches)

SAN коммутаторы бывают на любой вкус от 8 до сотен портов. Большинство модульных коммутаторов поставляется с 8 или 16 портами. Последним веянием является возможность наращивать количество портов на приобретенном коммутаторе с инкрементом 4. Типичным примером такого коммутатора может служить Qlogic SANbox 5200 (рис. 3). Этот продукт вы можете приобрести с 8-ю портами в базе, и наращивать затем до 16 в одном модуле и до 64 портов (!) в четырех модулях, соединяемых между собой 10 гигабитным FC.

Директоры или коммутаторы класса предприятия (director switches)

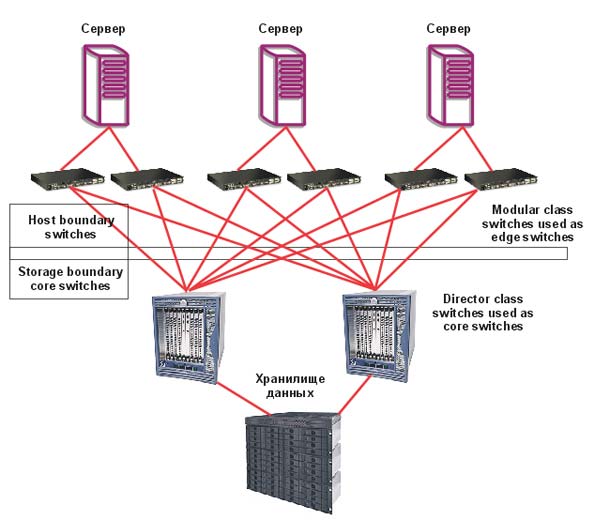

Директоры на много дороже модульных коммутаторов и обычно содержат сотни портов (рис. 4). Директоры можно увидеть в центре очень больших коммутированных фабрик в качестве ядра сети. Директоры обладают исключительной отказоустойчивостью и поддерживают работоспособность всей инфраструктуры 24 часа в сутки, 7 дней в неделю. Они позволяют осуществлять регламентные работы и замену модулей «на лету».

Рис. 4. SilkWorm 1200 128 port и McData InterPid 6140

Директор состоит из платформы, модулей портов горячей замены (обычно 12 или 16 портов) и процессорных модулей горячей замены (обычно двухпроцессорных). Директор можно приобрести с 32 портами и наращивать его до 128 – 140 портов.

В корпоративных сетях SAN обычно используют директоры в качестве ядра сети. К ним подключают модульные коммутаторы в качестве оконечных (граничных) коммутаторов. К тем, в свою очередь подключают серверы и хранилища. Такая топология называется ядро-граница (core-to-edge topology) и позволяет масштабировать сеть до тысяч портов (рис. 5).

Рис. 5. Топология ядро-граница с использованием директоров.

SAN маршрутизаторы или мультипротокльные коммутаторы (multiprotocol switches)

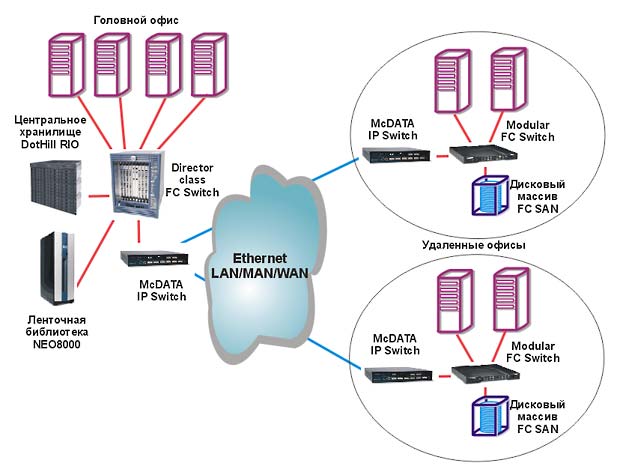

SAN маршрутизаторы служат для соединения удаленных островков SAN в единую сеть для решения задач защиты от катастроф, консолидации ресурсов хранения, организации процедур back-up данных удаленных подразделений на ленточные и дисковые ресурсы головного центра данных и т.д (рис 6.). Объединение удаленных сетей SAN в единый ресурс это следующий шаг в эволюции сетей хранения данных после внедрения SAN в головной структуре и подразделениях предприятий (рис. 7).

|  |  |

Рис. 6: McDATA Eclipse 1620, 3300 и 4300

Рис. 7: Объединение удаленных сетей SAN в единый ресурс

Островки SAN можно соединить, используя протокол FC и обычные модульные коммутаторы или директоры, через одномодовый оптический кабель (single mode cable или dark fiber) или же используя оборудование мультиплексирования (DWDM). Однако такой метод не позволит вам выйти за рамки города (радиус 70 км.). Для большего удаления понадобится протокол Fiber Channel over IP (FCIP, http://www.iscsistorage.com/ipstorage.htm), реализованный в маршрутизаторах Eclipse компании McData (рис. 6). FCIP «заворачивает» каждый кадр FC в пакет IP для транспорта через сеть IP. Принимающая сторона распаковывает пакет IP и достает оттуда оригинальный кадр FC для дальнейшей передачи уже по локальной сети FC. Здесь расстояния не ограничены. Все дело лишь в скорости вашего канала IP.

Типы FC кабелей

В качестве физической среды передачи данных в сетях FC используют оптоволоконный или медный кабель. Медный кабель представляет собой витую пару в оболочке и использовался в основном для местных подключений в сетях FC 1Gbit/s. В современных сетях FC 2Gbit/s в основном используется оптоволоконный кабель.

Существует два вида оптоволоконного кабеля: одномодовый и многомодовый.

Одномодовый кабель (long wave)

В одномодовом кабеле (SM) существует единственный путь распространения световой волны. Размер сердцевины (core size) обычно составляет 8.3 мк. Одномодовые кабели используются в устройствах, в которых требуется низкий уровень исчезновения (потери) сигнала и высокая скорость передачи данных, например на больших интервалах между двумя системами или сетевыми устройствами. Например, между сервером и хранилищем, расстояние между которыми, несколько десятков километров.

Максимальное расстояние между двумя узлами сети FC 2Gbit, соединенных одномодовым кабелем 80км без повторителей.

Многомодовый кабель (short wave)

Многомодовый кабель (MM) способен передавать по одному волокну несколько световых волн, так как относительно большой размер сердцевины позволяет свету распространяться под различными углами (рефракция). Типичными размерами сердцевины для MM являются 50 мк и 62.5 мк. Многомодовые волоконные соединения лучше всего подходят для устройств, работающих на небольших расстояниях. Внутри офиса, здания.

Максимальное расстояние на которое многомодовый кабель поддерживает скорость 2 Gbit/s – 300 (50um) и 150м (62,5 um).

Типы разъемов FC кабелей (Cable connector types)

Разъемы FC кабелей бывают:

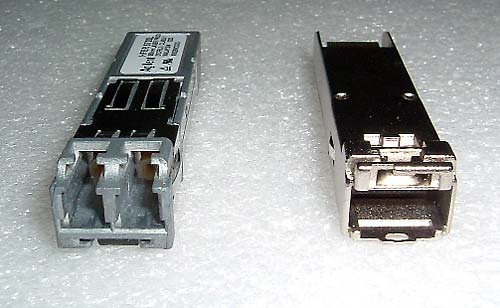

Типы трансиверов (GBIC types)

| |

| SFP-LC | HSSDC2 |

HSSDC2: для 1/2Gbit FC для медного кабеля

SFP-LC: (Small Form Factor Pluggable LC) 1/2Gbit FC Short/Long wave для оптоволоконного кабеля с LC коннектором

SFP-SC: (Small Form Factor Pluggable SC) 1/2Gbit FC Short/Long wave для оптоволоконного кабеля с SC коннектором

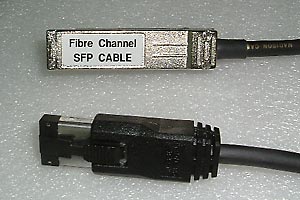

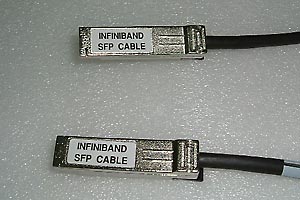

Кабели с трансиверами

Ряд производителей поставляют кабели уже с трансивером на конце

|  |

| Кабель HSSDC2-SFP | Кабель SFP-SFP |

Типы портов в SAN

Все FC порты на хосте или хранилище называются N_Ports, что означает Node Ports. Несколько сложнее обстоит дело с портами на коммутаторе. Режим работы порта коммутатора меняется в зависимости от того, какое устройство к нему подключено. Он бывает G_Port (Global Port) если к нему ничего не подключено. F_Port (Fabric Port), если к нему подключен хост или хранилище. E_Port (Expansion Port), если к нему подключен порт другого коммутатора (рис 10.)

SAN-коммутаторы: что это такое, как используется сеть хранения данных storage area network

Сетевые компьютерные системы, как и глобальные программные решения, используемые корпорациями, становятся все сложнее. Расширение их структуры обуславливает потребность в появлении технологии, обеспечивающей эффективное и надежное хранение информации. Подобным решением стали сторедж-системы, представляющие пользователям широкий функционал масштабирования и обеспечивающие высокую производительность. Именно они открыли доступ к использованию сторонних носителей, гарантируя при этом не только безопасность размещения, но и высокоскоростное чтение данных. Разработка и внедрение стандартов FC-AL (Fibre Channel — Arbitrated Loop) и SAN (Storage Area Network) — революционное для data-driven событие, заметно повлиявшее на дальнейшее развитие технических возможностей.

Общее представление

С технической точки зрения речь идет о решении, позволяющем подключать внешние накопители и устройства различных форматов, распознаваемые операционной системой в качестве локальных объектов. Использование подобных инструментов не только снижает совокупные издержки, но и обеспечивает условия, необходимые для организации надежного и безопасного хранилища информации.

Характеристика, предложенная международной ассоциацией, определяет, что сеть хранения данных SAN — это коммуникационная система, основной целью функционирования которой является обмен информацией между съемными БД и операционкой компьютера. Коммутаторы обеспечивают связь между устройствами, создавая полноценный пропускной канал, и отвечают за поддержание управленческого интерфейса, объединяющего сторедж и ОС.

История создания и развития

Технический прогресс обусловил формирование двух решений: серверов Network Attached Storage, или NAS, применяемых для размещения информации на файловом уровне, и сетевых хранилищ SAN, поддерживающих обмен в блочном формате. Для разделения традиционных и модернизированных систем в обращение был введен еще один термин — DAS, или Direct, обозначающий прямое подключение.

Последовательное появление на рынке указанных решений является отражением цикла эволюции программных продуктов, взаимодействующих с данными и байтами носителей, в которых они записаны. На ранних этапах развития приложения самостоятельно «читали и записывали» блоки, затем были внедрены драйверы, являющиеся частью ОС. Современная цепь объединяет три звена: генерацию массива Redundant Array of Independent Disks, обработку интерпретирующих метаданных, а также сервисы, передающие их приложению. Отличие между DAS, SAN и NAS сводится к специфике реализации указанных элементов: в первом случае конфигурация отвечает только за хранение и доступ, тогда как остальной функционал реализуется на серверной стороне; второй формат предусматривает перенос RAID в зону ответственности сети; третий — требует только лишь поддержки сервиса, поскольку файловая информация также переносится в систему.

Возникновению СХД (системы хранения данных) способствовала разработка протокола FC, принятого в 1994 году в качестве стандарта ANSI. В дальнейшем его место занял Ethernet, и, как следствие, массовое распространение получили новые сетевые конфигурации, включая IP-SAN.

О сетях хранения данных

Решил написать небольшую статейку о сетях хранения данных (СХД), тема эта достаточно интересная, но на Хабре почему-то не раскрыта. Постараюсь поделиться личным опытом по построению и поддержке SAN.

Что это?

Сеть хранения данных, или Storage Area Network — это система, состоящая из собственно устройств хранения данных — дисковых, или RAID — массивов, ленточных библиотек и прочего, среды передачи данных и подключенных к ней серверов. Обычно используется достаточно крупными компаниями, имеющими развитую IT инфраструктуру, для надежного хранения данных и скоростного доступа к ним.

Упрощенно, СХД — это система, позволяющая раздавать серверам надежные быстрые диски изменяемой емкости с разных устройств хранения данных.

Немного теории.

Сервер к хранилищу данных можно подключить несколькими способами.

Первый и самый простой — DAS, Direct Attached Storage (прямое подключение), без затей ставим диски в сервер, или массив в адаптер сервера — и получаем много гигабайт дискового пространства со сравнительно быстрым доступом, и при использовании RAID-массива — достаточную надежность, хотя копья на тему надежности ломают уже давно.

Однако такое использование дискового пространства не оптимально — на одном сервере место кончается, на другом его еще много. Решение этой проблемы — NAS, Network Attached Storage (хранилище, подключенное по сети). Однако при всех преимуществах этого решения — гибкости и централизованного управления — есть один существенный недостаток — скорость доступа, еще не во всех организациях внедрена сеть 10 гигабит. И мы подходим к сети хранения данных.

Главное отличие SAN от NAS (помимо порядка букв в аббревиатурах) — это то, каким образом видятся подключаемые ресурсы на сервере. Если в NAS ресурсы подключаются протоколам NFS или SMB, в SAN мы получаем подключение к диску, с которым можем работать на уровне операций блочного ввода-вывода, что гораздо быстрее сетевого подключения (плюс контроллер массива с большим кэшем добавляет скорости на многих операциях).

Используя SAN, мы сочетаем преимущества DAS — скорость и простоту, и NAS — гибкость и управляемость. Плюс получаем возможность масштабирования систем хранения до тех пор, пока хватает денег, параллельно убивая одним выстрелом еще несколько зайцев, которых сразу не видно:

* снимаем ограничения на дальность подключения SCSI-устройств, которые обычно ограничены проводом в 12 метров,

* уменьшаем время резервного копирования,

* можем грузиться с SAN,

* в случае отказа от NAS разгружаем сеть,

* получаем большую скорость ввода-вывода за счет оптимизации на стороне системы хранения,

* получаем возможность подключать несколько серверов к одному ресурсу, то нам дает следующих двух зайцев:

o на полную используем возможности VMWare — например VMotion (миграцию виртуальной машины между физическими) и иже с ними,

o можем строить отказоустойчивые кластеры и организовывать территориально распределенные сети.

Что это дает?

Помимо освоения бюджета оптимизации системы хранения данных, мы получаем, вдобавок к тому что я написал выше:

* увеличение производительности, балансировку нагрузки и высокую доступность систем хранения за счет нескольких путей доступа к массивам;

* экономию на дисках за счет оптимизации расположения информации;

* ускоренное восстановление после сбоев — можно создать временные ресурсы, развернуть на них backup и подключить к ним сервера, а самим без спешки восстанавливать информацию, или перекинуть ресурсы на другие сервера и спокойно разбираться с умершим железом;

* уменьшение время резервного копирования — благодаря высокой скорости передачи можно бэкапиться на ленточную библиотеку быстрее, или вообще сделать snapshot (мгновенный снимок) с файловой системы и спокойно архивировать его;

* дисковое место по требованию — когда нам нужно — всегда можно добавить пару полок в систему хранения данных.

* уменьшаем стоимость хранения мегабайта информации — естественно, есть определенный порог, с которого эти системы рентабельны.

* надежное место для хранения mission critical и business critical данных (без которых организация не может существовать и нормально работать).

* отдельно хочу упомянуть VMWare — полностью все фишки вроде миграции виртуальных машин с сервера на сервер и прочих вкусностей доступны только на SAN.

Из чего это состоит?

Как я писал выше — СХД состоит из устройств хранения, среды передачи и подключенных серверов. Рассмотрим по порядку:

Системы хранения данных обычно состоят из жестких дисков и контроллеров, в уважающей себя системе как правило всего по 2 — по 2 контроллера, по 2 пути к каждому диску, по 2 интерфейса, по 2 блока питания, по 2 администратора. Из наиболее уважаемых производителей систем следует упомянуть HP, IBM, EMC и Hitachi. Тут процитирую одного представителя EMC на семинаре — «Компания HP делает отличные принтеры. Вот пусть она их и делает!» Подозреваю, что в HP тоже очень любят EMC. Конкуренция между производителями нешуточная, впрочем, как и везде. Последствия конкуренции — иногда вменяемые цены за мегабайт системы хранения и проблемы с совместимостью и поддержкой стандартов конкурентов, особенно у старого оборудования.

Среда передачи данных. Обычно SAN строят на оптике, это дает на текущий момент скорость в 4, местами в 8 гигабит на канал. При построении раньше использовались специализированные хабы, сейчас больше свитчи, в основном от Qlogic, Brocade, McData и Cisco (последние два на площадках не видел ни разу). Кабели используются традиционные для оптических сетей — одномодовые и многомодовые, одномодовые более дальнобойные.

Внутри используется FCP — Fibre Channel Protocol, транспортный протокол. Как правило внутри него бегает классический SCSI, а FCP обеспечивает адресацию и доставку. Есть вариант с подключением по обычной сети и iSCSI, но он обычно использует (и сильно грузит) локальную, а не выделенную под передачу данных сеть, и требует адаптеров с поддержкой iSCSI, ну и скорость помедленнее, чем по оптике.

Есть еще умное слово топология, которое встречается во всех учебниках по SAN. Топологий несколько, простейший вариант — точка-точка (point to point), соединяем между собой 2 системы. Это не DAS, а сферический конь в вакууме простейший вариант SAN. Дальше идет управляемая петля (FC-AL), она работает по принципу «передай дальше» — передатчик каждого устройства соединен с приемником последующего, устройства замкнуты в кольцо. Длинные цепочки имеют свойство долго инициализироваться.

Ну и заключительный вариант — коммутируемая структура (Fabric), она создается с помощью свитчей. Структура подключений строится в зависимости от количества подключаемых портов, как и при построении локальной сети. Основной принцип построения — все пути и связи дублируются. Это значит, что до каждого устройства в сети есть минимум 2 разных пути. Здесь тоже употребимо слово топология, в смысле организации схемы подключений устройств и соединения свитчей. При этом как правило свитчи настраиваются так, что сервера не видят ничего, кроме предназначенных им ресурсов. Это достигается за счет создания виртуальных сетей и называется зонированием, ближайшая аналогия — VLAN. Каждому устройству в сети присваивается аналог MAC-адреса в сети Ethernet, он называется WWN — World Wide Name. Он присваивается каждому интерфейсу и каждому ресурсу (LUN) систем хранения данных. Массивы и свитчи умеют разграничивать доступ по WWN для серверов.

А дальше на системах хранения нарезаются ресурсы, они же диски (LUN) для каждого сервера и оставляется место в запас, все включается, установщики системы прописывают топологию, ловят глюки в настройке свитчей и доступа, все запускается и все живут долго и счастливо*.

Я специально не касаюсь разных типов портов в оптической сети, кому надо — тот и так знает или прочитает, кому не надо — только голову забивать. Но как обычно, при неверно установленном типе порта ничего работать не будет.

Из опыта.

Обычно при создании SAN заказывают массивы с несколькими типами дисков: FC для скоростных приложений, и SATA или SAS для не очень быстрых. Таким образом получаются 2 дисковые группы с различной стоимостью мегабайта — дорогая и быстрая, и медленная и печальная дешевая. На быструю вешаются обычно все базы данных и прочие приложения с активным и быстрым вводом-выводом, на медленную — файловые ресурсы и все остальное.

Если SAN создается с нуля — имеет смысл строить ее на основе решений от одного производителя. Дело в том, что, несмотря на заявленное соответствие стандартам, существуют подводные грабли проблемы совместимости оборудования, и не факт, что часть оборудования будет работать друг с другом без плясок с бубном и консультаций с производителями. Обычно для утряски таких проблем проще позвать интегратора и дать ему денег, чем общаться с переводящими друг на друга стрелки производителями.

Если SAN создается на базе существующей инфраструктуры — все может быть сложно, особенно если есть старые SCSI массивы и зоопарк старой техники от разных производителей. В этом случае имеет смысл звать на помощь страшного зверя интегратора, который будет распутывать проблемы совместимости и наживать третью виллу на Канарах.

Часто при создании СХД фирмы не заказывают поддержку системы производителем. Обычно это оправдано, если у фирмы есть штат грамотных компетентных админов (которые уже 100 раз назвали меня чайником) и изрядный капитал, позволяющий закупить запасные комплектующие в потребных количествах. Однако компетентных админов обычно переманивают интеграторы (сам видел), а денег на закупку не выделяют, и после сбоев начинается цирк с криками «Всех уволю!» вместо звонка в саппорт и приезда инженера с запасной деталью.

Поддержка обычно сводится к замене умерших дисков и контроллеров, ну и к добавлению в систему полок с дисками и новых серверов. Много хлопот бывает после внезапной профилактики системы силами местных специалистов, особенно после полного останова и разборки-сборки системы (и такое бывает).

Про VMWare. Насколько я знаю (спецы по виртуализации поправьте меня), только у VMWare и Hyper-V есть функционал, позволяющий «на лету» перекидывать виртуальные машины между физическими серверами. И для его реализации требуется, чтобы все сервера, между которыми перемещается виртуальная машина, были подсоединены к одному диску.

Про кластеры. Аналогично случаю с VMWare, известные мне системы построения отказоустойчивых кластеров (Sun Cluster, Veritas Cluster Server) — требуют подключенного ко всем системам хранилища.

Пока писал статью — у меня спросили — в какие RAIDы обычно объединяют диски?

В моей практике обычно делали или по RAID 1+0 на каждую дисковую полку с FC дисками, оставляя 1 запасной диск (Hot Spare) и нарезали из этого куска LUN-ы под задачи, или делали RAID5 из медленных дисков, опять же оставляя 1 диск на замену. Но тут вопрос сложный, и обычно способ организации дисков в массиве выбирается под каждую ситуацию и обосновывается. Та же EMC например идет еще дальше, и у них есть дополнительная настройка массива под приложения, работающие с ним (например под OLTP, OLAP). С остальными вендорами я так глубоко не копал, но догадываюсь, что тонкая настройка есть у каждого.

* до первого серьезного сбоя, после него обычно покупается поддержка у производителя или поставщика системы.

Поскольку в песочнице комментариев нет, закину в личный блог.

SAS, NAS, SAN: шаг к сетям хранения данных

Вступление

С повседневным усложнением сетевых компьютерных систем и глобальных корпоративных решений мир начал требовать технологий, которые бы дали толчок к возрождению корпоративных систем хранения информации (сторедж-систем). И вот, одна единая технология приносит в мировую сокровищницу достижений в области сторедж невиданное ранее быстродействие, колоссальные возможности масштабирования и исключительные преимущества общей стоимости владения. Обстоятельства, которые сформировались с появлением стандарта FC-AL (Fibre Channel — Arbitrated Loop) и SAN (Storage Area Network), которая развивается на его основе, обещают революцию в дата-ориентированных технологиях компьютинга.

«The most significant development in storage we’ve seen in 15 years»

Data Communications International, March 21, 1998

Формальное определение SAN в трактовке Storage Network Industry Association (SNIA):

«Сеть, главной задачей которой является передача данных между компьютерными системами и устройствами хранения данных, а также между самими сторедж-системами. SAN состоит из коммуникационной инфраструктуры, которая обеспечивает физическую связь, а также отвечает за уровень управления (management layer), который объединяет связи, сторедж и компьютерные системы, осуществляя передачу данных безопасно и надежно».

SNIA Technical Dictionary, copyright Storage Network Industry Association, 2000

Варианты организации доступа к сторедж-системам

Рассмотрим топологии соответствующих сторедж-систем и их особенности.

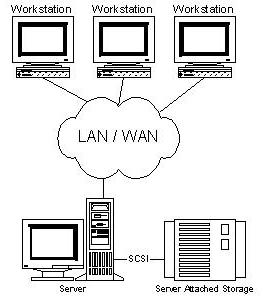

Сторедж-система, присоединенная к серверу. Знакомый всем, традиционный способ подключения системы хранения данных к высокоскоростному интерфейсу в сервере, как правило, к параллельному SCSI интерфейсу.

Рисунок 1. Server Attached Storage

Использование отдельного корпуса для сторедж-системы в рамках топологии SAS не является обязательным.

Основное преимущество сторедж, подсоединенного к серверу, в сравнении с другими вариантами — низкая цена и высокое быстродействие из расчета один сторедж для одного сервера. Такая топология является самой оптимальной в случае использования одного сервера, через который организуется доступ к массиву данных. Но у нее остается ряд проблем, которые побудили проектировщиков искать другие варианты организации доступа к системам хранения данных.

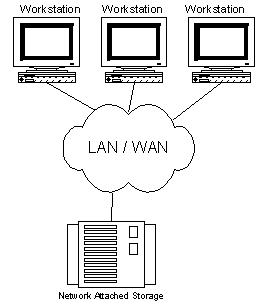

Сторедж-система, подсоединенная к сети. Этот вариант организации доступа появился сравнительно недавно. Основным его преимуществом является удобство интеграции дополнительной системы хранения данных в существующие сети, но сам по себе он не привносит сколь-нибудь радикальных улучшений в архитектуру сторедж. Фактически NAS есть чистый файл-сервер, и сегодня можно встретить немало новых реализаций сторедж типа NAS на основе технологии тонкого сервера (Thin Server).

Рисунок 2. Network Attached Storage.

Сторедж, построенный по технологии NAS, является идеальным вариантом для дешевых серверов с минимальным набором функций.

Сети хранения данных начали интенсивно развиваться и внедряться лишь с 1999 года. Основой SAN является отдельная от LAN/WAN сеть, которая служит для организации доступа к данным серверов и рабочих станций, занимающихся их прямой обработкой. Такая сеть создается на основе стандарта Fibre Channel, что дает сторедж-системам преимущества технологий LAN/WAN и возможности по организации стандартных платформ для систем с высокой готовностью и высокой интенсивностью запросов. Почти единственным недостатком SAN на сегодня остается относительно высокая цена компонент, но при этом общая стоимость владения для корпоративных систем, построенных с использованием технологии сетей хранения данных, является довольно низкой.

Рисунок 3. Storage Area Network.

Следует также заметить, что технология эта еще довольно молодая и в ближайшее время она должна пережить немало усовершенствований в области стандартизации управления и способов взаимодействия SAN подсетей. Но можно надеяться, что это угрожает пионерам лишь дополнительными перспективами первенства.

FC как основа построения SAN

Подобно LAN, SAN может создаваться с использованием различных топологий и носителей. При построении SAN может использоваться как параллельный SCSI интерфейс, так и Fibre Channel или, скажем, SCI (Scalable Coherent Interface), но своей все возрастающей популярностью SAN обязана именно Fibre Channel. В проектировании этого интерфейса принимали участие специалисты со значительным опытом в разработке как канальных, так и сетевых интерфейсов, и им удалось объединить все важные положительные черты обеих технологий для того, чтобы получить что-то в самом деле революционно новое. Что именно?

Традиционно сторедж интерфейсы (то, что находится между хостом и устройствами хранения информации) были преградой на пути к росту быстродействия и увеличению объема систем хранения данных. В то же время прикладные задачи требуют значительного прироста аппаратных мощностей, которые, в свою очередь, тянут за собой потребность в увеличении пропускной способности интерфейсов для связи со сторедж-системами. Именно проблемы построения гибкого высокоскоростного доступа к данным помогает решить Fibre Channel.

Стандарт Fibre Channel был окончательно определен за последние несколько лет (с 1997-го по 1999-й), на протяжении которых была проведена колоссальная работа по согласованию взаимодействия производителей различных компонент, и было сделано все необходимое, чтобы Fibre Channel превратился из чисто концептуальной технологии в реальную, которая получила поддержку в виде инсталляций в лабораториях и вычислительных центрах. В году 1997 были спроектированы первые коммерческие образцы краеугольных компонент для построения SAN на базе FC, таких как адаптеры, хабы, свичи и мосты. Таким образом, уже начиная с 1998-го года FC используется в коммерческих целях в деловой сфере, на производстве и в масштабных проектах реализации систем, критичных к отказам.

Fibre Channel — это открытый промышленный стандарт высокоскоростного последовательного интерфейса. Он обеспечивает подключение серверов и сторедж-систем на расстоянии до 10 км (при использовании стандартного оснащения) на скорости 100 MB/s (на выставке Cebit’2000 были представлены образцы продукции, которые используют новый стандарт Fibre Channel со скоростями 200 MB/s на одно кольцо, а в лабораторных условиях уже эксплуатируются реализации нового стандарта со скоростями 400 MB/s, что составляет 800 MB/s при использовании двойного кольца). (На момент публикации статьи ряд производителей уже начал отгружать сетевые карточки и свичи на FC 200 MB/s.) Fibre Channel одновременно поддерживает целый ряд стандартных протоколов (среди которых TCP/IP и SCSI-3) при использовании одного физического носителя, который потенциально упрощает построение сетевой инфраструктуры, к тому же это предоставляет возможности для уменьшения стоимости монтажа и обслуживания. Тем не менее использование отдельных подсетей для LAN/WAN и SAN имеет ряд преимуществ и является рекомендованным по умолчанию.

Одним из важнейших преимуществ Fibre Channel наряду со скоростными параметрами (которые, кстати, не всегда являются главными для пользователей SAN и могут быть реализованы с помощью других технологий) является возможность работы на больших расстояниях и гибкость топологии, которая пришла в новый стандарт из сетевых технологий. Таким образом, концепция построения топологии сети хранения данных базируется на тех же принципах, что и традиционные сети, как правило, на основе концентраторов и коммутаторов, которые помогают предотвратить падение скорости при возрастании количества нод и создают возможности удобной организации систем без единой точки отказов.

Для лучшего понимания преимуществ и особенностей этого интерфейса приведем сравнительную характеристику FC и Parallel SCSI в виде таблицы.

Таблица 1. Сравнение технологий Fibre Channel и параллельного SCSI

| Fibre Channel | Parallel SCSI |

|---|---|

| Быстродействие | 100MB/sec |

Новый стандарт: 320MB/sec

Fiber optic: 2-10km

Copper, differential: 25m

В стандарте Fibre Channel предполагается использование разнообразных топологий, таких как точка-точка (Point-to-Point), кольцо или FC-AL концентратор (Loop или Hub FC-AL), магистральный коммутатор (Fabric/Switch).

Топология point-to-point используется для подсоединения одиночной сторедж-системы к серверу.

Loop или Hub FC-AL — для подсоединения множественных сторедж устройств к нескольким хостам. При организации двойного кольца увеличивается быстродействие и отказоустойчивость системы.

Коммутаторы используются для обеспечения максимального быстродействия и отказоустойчивости для сложных, больших и разветвленных систем.

Благодаря сетевой гибкости в SAN заложена чрезвычайно важная особенность — удобная возможность построения отказоустойчивых систем.

Предлагая альтернативные решения для систем хранения данных и возможности по объединению нескольких сторедж для резервирования аппаратных средств, SAN помогает обеспечивать защиту аппаратно-программных комплексов от аппаратных сбоев. Для демонстрации приведем пример создания двухнодовой системы без точек отказов.

Рисунок 4. No Single Point of Failure.

Построение трех- и более нодовых систем осуществляется простым добавлением в FC сеть дополнительных серверов и подключением их к обоим концентраторам/ коммутаторам).

При использовании FC построение устойчивых к сбоям (disaster tolerant) систем становится прозрачным. Сетевые каналы и для сторедж, и для локальной сети можно проложить на основе оптоволокна (до 10 км и больше с использованием усилителей сигнала) как физического носителя для FC, при этом используется стандартная аппаратура, которая дает возможность значительно уменьшить стоимость подобных систем.

Благодаря возможности доступа ко всем компонентам SAN из любой ее точки мы получаем чрезвычайно гибко управляемую сеть данных. При этом следует заметить, что в SAN обеспечивается прозрачность (возможность видеть) всех компонентов вплоть до дисков в сторедж-системах. Эта особенность подтолкнула производителей компонентов к использованию своего значительного опыта в построении систем управления для LAN/WAN с тем, чтобы заложить широкие возможности по мониторингу и управлению во все компоненты SAN. Эти возможности включают в себя мониторинг и управление отдельных нод, сторедж компонентов, корпусов, сетевых устройств и сетевых подструктур.

Системы, построенные с использованием технологий SAN, не только обеспечивают администратору возможность следить за развитием и состоянием сторедж ресурсов, но и открывают возможности по мониторингу и контролю трафика. Благодаря таким ресурсам программные средства управления SAN реализуют наиболее эффективные схемы планирования объема сторедж и балансирование нагрузки на компоненты системы.

Сети хранения данных прекрасно интегрируются в существующие информационные инфраструктуры. Их внедрение не требует каких-либо изменений в уже существующих сетях LAN и WAN, а лишь расширяет возможности существующих систем, избавляя их от задач, ориентированных на передачу больших объемов данных. Причем при интеграции и администрировании SAN очень важным является то, что ключевые элементы сети поддерживают горячую замену и установку, с возможностями динамического конфигурирования. Так что добавить тот или другой компонент или осуществить его замену администратор может, не выключая систему. И весь этот процесс интеграции может быть визуально отображен в графической системе управления SAN.

Рассмотрев вышеперечисленные преимущества, можно выделить ряд ключевых моментов, которые непосредственно влияют на одно из основных преимуществ Storage Area Network — общую стоимость владения (Total Cost Ownership).

Невероятные возможности масштабирования позволяют предприятию, которое использует SAN, вкладывать деньги в серверы и сторедж по мере необходимости. А также сохранить свои вложения в уже инсталлированную технику при смене технологических поколений. Каждый новый сервер будет иметь возможность высокоскоростного доступа к сторедж и каждый дополнительный гигабайт сторедж будет доступен всем серверам подсети по команде администратора.

Прекрасные возможности по построению отказоустойчивых систем могут приносить прямую коммерческую выгоду от минимизации простоев и спасать систему в случае возникновения стихийного бедствия или каких-нибудь других катаклизмов.

Управляемость компонентов и прозрачность системы предоставляют возможность осуществлять централизованное администрирование всех сторедж ресурсов, а это, в свою очередь, значительно уменьшает затраты на их поддержку, стоимость которой, как правило, составляет более 50% от стоимости оснащения.

Влияние SAN на прикладные задачи

Для того чтобы нашим читателям стало понятней, насколько практически полезны технологии, которые рассматриваются в этой статье, приведем несколько примеров прикладных задач, которые без использования сетей хранения данных решались бы неэффективно, требовали бы колоссальных финансовых вложений или же вообще не решались бы стандартными методами.

Резервирование и восстановление данных (Data Backup and Recovery)

Используя традиционный SCSI интерфейс, пользователь при построении систем резервирования и восстановления данных сталкивается с рядом сложных проблем, которые можно очень просто решить, используя технологии SAN и FC.

| Проблемы (Data Backup and Recovery) | Решение с использованием технологий SAN и FC |

|---|---|

| Загрузка LAN | LAN-free Backup (отдельная сторедж сеть) |

| Загрузка серверов | Serverless Backup (storage to storage) |

| Проблема отдаленного резервирования | Удаление сторедж на расстояние > 10km через FC с использованием FC/WAN Gateway |

| Маленькое окно (отсутствие времени) для backup | Высокая пропускная способность сети FC |

Таким образом, использование сетей хранения данных выводит решение задачи резервирования и восстановления на новый уровень и предоставляет возможность осуществлять бэкап в несколько раз быстрее, чем раньше, без загрузки локальной сети и серверов работой по резервированию данных.

Кластеризация серверов (Server Clustering)

Одной из типичных задач, для которых эффективно используется SAN, является кластеризация серверов. Поскольку один из ключевых моментов в организации высокоскоростных кластерных систем, которые работают с данными — это доступ к сторедж, то с появлением SAN построение многонодовых кластеров на аппаратном уровне решается простым добавлением сервера с подключением к SAN (это можно сделать, даже не выключая системы, поскольку свичи FC поддерживают hot-plug). При использовании параллельного SCSI интерфейса, возможности по подсоединению и масштабируемость которого значительно хуже, чем у FC, кластеры, ориентированные на обработку данных, было бы тяжело сделать с количеством нод больше двух. Коммутаторы параллельного SCSI — весьма сложные и дорогие устройства, а для FC это стандартный компонент. Для создания кластера, который не будет иметь ни единой точки отказов, достаточно интегрировать в систему зеркальную SAN (технология DUAL Path).

Одновременный доступ к видео и распределение данных (Concurrent video streaming, data sharing)

Вообразите себе задачу, когда вам нужно на нескольких (скажем, >5) станциях редактировать видео или просто работать над данными огромного объема. Передача файла размером 100GB по локальной сети займет у вас несколько минут, а общая работа над ним будет очень сложной задачей. При использовании SAN каждая рабочая станция и сервер сети получают доступ к файлу на скорости, эквивалентной локальному высокоскоростному диску. Если вам нужны еще одна станция/сервер для обработки данных, вы сможете ее прибавить к SAN, не выключая сети, простым подсоединением станции к SAN коммутатору и предоставлением ей прав доступа к сторедж. Если же вас перестанет удовлетворять быстродействие подсистемы данных, вы сможете просто прибавить еще один сторедж и с использованием технологии распределения данных (например, RAID 0) получить вдвое большее быстродействие.

Основные компоненты SAN

Среда

Для соединения компонентов в рамках стандарта Fibre Channel используют медные и оптические кабели. Оба типа кабелей могут использоваться одновременно при построении SAN. Конверсия интерфейсов осуществляется с помощью GBIC (Gigabit Interface Converter) и MIA (Media Interface Adapter). Оба типа кабеля сегодня обеспечивают одинаковую скорость передачи данных. Медный кабель используется для коротких расстояний (до 30 метров), оптический — как для коротких, так и для расстояний до 10 км и больше. Используют многомодовый и одномодовый оптические кабели. Многомодовый (Multimode) кабель используется для коротких расстояний (до 2 км). Внутренний диаметр оптоволокна мультимодового кабеля составляет 62,5 или 50 микрон. Для обеспечения скорости передачи 100 МБ/с (200 МБ/с в дуплексе) при использовании многомодового оптоволокна длина кабеля не должна превышать 200 метров. Одномодовый кабель используется для больших расстояний. Длина такого кабеля ограничена мощностью лазера, который используется в передатчике сигнала. Внутренний диаметр оптоволокна одномодового кабеля составляет 7 или 9 микрон, он обеспечивает прохождение одиночного луча.

Коннекторы, адаптеры

Для подсоединения медных кабелей используются коннекторы типа DB-9 или HSSD. HSSD считается более надежным, но DB-9 используется так же часто, потому что он более простой и дешевый. Стандартным (наиболее распространенным) коннектором для оптических кабелей является SC коннектор, он обеспечивает качественное, четкое соединение. Для обычного подключения используются многомодовые SC коннекторы, а для отдаленного — одномодовые. В многопортовых адаптерах используются микроконнекторы.

Наиболее распространены адаптеры для FC под шину PCI 64 bit. Также много FC адаптеров вырабатывается под шину S-BUS, для специализированного использования выпускаются адаптеры под MCA, EISA, GIO, HIO, PMC, Compact PCI. Самые популярные — однопортовые, встречаются двух- и четырехпортовые карточки. На PCI адаптерах, как правило, используют DB-9, HSSD, SC коннекторы. Также часто встречаются GBIC-based адаптеры, которые поставляются как с модулями GBIC, так и без них. Fibre Channel адаптеры отличаются классами, которые они поддерживают, и разнообразными особенностями. Для понимания отличий приведем сравнительную таблицу адаптеров производства фирмы QLogic.

| Fibre Channel Host Bus Adapter Family Chart | ||||||||||||||

|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|

| SANblade | 64 Bit | FCAL Publ. Pvt Loop | FL Port | Class 3 | F Port | Class 2 | Point to Point | IP/ SCSI | Full Duplex | FC Tape | PCI 1.0 Hot Plug Spec | Solaris Dynamic Reconfig | VIВ | 2Gb |

| 2100 Series | 33 & 66MHz PCI | X | X | X | ||||||||||

| 2200 Series | 33 & 66MHz PCI | X | X | X | X | X | X | X | X | X | ||||

| 33MHz PCI | X | X | X | X | X | X | X | X | X | X | ||||

| 25 MHZ Sbus | X | X | X | X | X | X | X | X | X | X | ||||

| 2300 Series | 66 MHZ PCI/ 133MHZ PCI-X | X | X | X | X | X | X | X | X | X | X | X | ||

Концентраторы

Fibre Channel HUBs (концентраторы) используются для подключения нод к FC кольцу (FC Loop) и имеют структуру, похожую на Token Ring концентраторы. Поскольку разрыв кольца может привести к прекращению функционирования сети, в современных FC концентраторах используются порты обхода кольца (PBC-port bypass circuit), которые разрешают автоматически открывать/закрывать кольцо (подключать/отключать системы, присоединенные к концентратору). Обычно FC HUBs поддерживают до 10 подключений и могут стекироваться до 127 портов на кольцо. Все устройства, подключенные к HUB, получают общую полосу пропускания, которую они могут разделять между собой.

Коммутаторы

Fibre Channel Switches (коммутаторы) имеют те же функции, что и привычные читателю LAN коммутаторы. Они обеспечивают полноскоростное неблокированное подключение между нодами. Любая нода, подключенная к FC коммутатору, получает полную (с возможностями масштабирования) полосу пропускания. При увеличении количества портов коммутированной сети ее пропускная способность увеличивается. Коммутаторы могут использоваться вместе с концентраторами (которые используют для участков, не требующих выделенной полосы пропуска для каждой ноды) для достижения оптимального соотношения цена/производительность. Благодаря каскадированию свичи потенциально могут использоваться для создания FC сетей с количеством адресов 2 24 (свыше 16 миллионов).

Мосты

FC Bridges (мосты или мультиплексоры) используются для подключения устройств с параллельным SCSI к сети на базе FC. Они обеспечивают трансляцию SCSI пакетов между Fibre Channel и Parallel SCSI устройствами, примерами которых могут служить Solid State Disk (SSD) или библиотеки на магнитных лентах. Следует заметить, что в последнее время практически все устройства, которые могут быть утилизированы в рамках SAN, производители начинают выпускать с вмонтированным FC интерфейсом для прямого их подключения к сетям хранения данных.

Серверы и Сторедж

Несмотря на то что серверы и сторедж — далеко не последние по важности компоненты SAN, мы на их описании останавливаться не будем, поскольку уверены, что с ними хорошо знакомы все наши читатели.

В конце хочется добавить, что эта статья — лишь первый шаг к сетям хранения данных. Для полного понимания темы читателю следует уделить немало внимания особенностям реализации компонент производителями SAN и программным средствам управления, поскольку без них Storage Area Network — это всего лишь набор элементов для коммутации сторедж-систем, которые не принесут вам полноты преимуществ от реализации сети хранения данных.

Заключение

Сегодня Storage Area Network является довольно новой технологией, которая в скором времени может стать массовой в кругу корпоративных заказчиков. В Европе и США предприятия, которые имеют достаточно большой парк инсталлированных сторедж-систем, уже начинают переходить на сети хранения данных для организации сторедж с наилучшим показателем общей стоимости владения.

По прогнозам аналитиков, в 2005 году значительное количество серверов среднего и верхнего уровня будут поставляться с предварительно установленным интерфейсом Fibre Channel (такую тенденцию можно заметить уже сегодня), и лишь для внутреннего подключения дисков в серверах будет использоваться параллельный SCSI интерфейс. Уже сегодня при построении сторедж-систем и приобретении серверов среднего и верхнего уровня следует обратить внимание на эту перспективную технологию, тем более, что уже сегодня она дает возможность реализовать ряд задач куда дешевле, чем с помощью специализированных решений. Кроме того, вкладывая в технологию SAN сегодня, вы не потеряете свои вложения завтра, поскольку особенности Fibre Channel создают прекрасные возможности для использования в будущем вложенных сегодня инвестиций.

Предыдущая версия статьи была написана в июне 2000 года, но в связи с отсутствием массового интереса к технологии сетей хранения данных публикация была отложена на будущее. Это будущее настало сегодня, и я надеюсь, что данная статья побудит читателя осознать необходимость перехода на технологию сетей хранения данных, как передовую технологию построения сторедж-систем и организации доступа к данным.