Self-managed OpenShift

Red Hat OpenShift Container Platform

A hybrid cloud, enterprise Kubernetes platform to build and deliver better applications faster

Red Hat® OpenShift® Container Platform is a consistent hybrid cloud foundation for building and scaling containerized applications. Benefit from streamlined platform installation and upgrades from one of the enterprise Kubernetes leaders.

Expertise from Kubernetes leaders

Red Hat OpenShift is trusted by more than 2,000 customers to deliver business-critical applications, whether they’re migrating existing workloads to the cloud or building new, innovative experiences for their users. Red Hat OpenShift is backed by a 9-year enterprise support life cycle from one of the leading Kubernetes contributors, Red Hat.

Features & benefits

Push-button upgrades, cloud-like ease

Red Hat OpenShift comes with a streamlined, automatic install so you can get up and running with Kubernetes as quickly as possible. Once installed, Red Hat OpenShift uses Kubernetes Operators for push-button, automatic platform updates for the container host, Kubernetes cluster, and application services running on the cluster.

Consistent foundation for on-premise and public cloud workloads

Red Hat OpenShift Container Platform delivers a single, consistent Kubernetes platform anywhere that Red Hat® Enterprise Linux® runs. The platform ships with a user-friendly console to view and manage all your clusters so you have enhanced visibility across multiple deployments.

Build and deliver faster

Red Hat OpenShift comes with developer-friendly workflows including built-in CI/CD pipelines and our source-to-image capability that enables you to go straight from application code to container. Extend to new technologies—including serverless applications with Knative, cloud services, and streamlined service communications with Istio and service mesh.

More features & benefits

Trusted platform

Red Hat OpenShift builds security checks into your container stack—starting with Red Hat® Enterprise Linux® and continuing throughout the application life cycle.

Built-in monitoring

Red Hat OpenShift includes Prometheus, the standard for cloud-native cluster and application monitoring. Use Grafana dashboards for visualization.

On-demand environments

Self-service for application teams to access approved services and infrastructure, with centralized management and administration.

Ecosystem integration

Red Hat has worked with hundreds of partners to validate technology integrations with Red Hat OpenShift, so organizations can make the most of their existing investments.

Centralized policy management

Red Hat OpenShift gives administrators a single place to implement and enforce policies across multiple teams, with a unified console across all Red Hat OpenShift clusters.

Certified Kubernetes

Red Hat OpenShift is part of the Cloud Native Computing Foundation (CNCF) Certified Kubernetes program, ensuring compatibility and interoperability between your container workloads.

Technologies supported by Red Hat OpenShift Container Platform

Red Hat OpenShift extends to databases, frameworks, and tools so your teams can move faster.

Red Hat AMQ Streams

Explore related resources

Analyst report

The business value of Red Hat OpenShift

Datasheet

Red Hat OpenShift sizing and subscription guide

Success story

Poste Italiane creates cloud-ready digital platform with Red Hat

The Red Hat subscription advantage

A Red Hat subscription offers production-ready code, life-cycle management, software interoperability, and the flexibility to choose from multiple supported versions.

It also gives you access to a community of experts, thousands of software, cloud, and hardware partners, knowledge resources, security updates, and support tools that you can’t get anywhere else.

Red Hat OpenShift

Управляйте развертываниями в гибридных и мультиоблачных средах

Red Hat® OpenShift®- это готовая корпоративная контейнерная платформа Kubernetes с полным стеком автоматизированных операций с поддержкой гибридных и мультиоблачных развертываний. Red Hat OpenShift оптимизирована для повышения производительности труда разработчиков и внедрения инноваций.

Превращайте ваши идеи в развернутые системы, которые легко масштабировать. Red Hat OpenShift 4 включает Red Hat Enterprise Linux® CoreOS, с установкой в один шаг, повышенной отказоустойчивостью и производительностью, а еще дружественную разработчикам serverless среду.

Как работает Red Hat OpenShift

Совместная работа в проектах

Легковесные контейнеры

Red Hat OpenShift оснащена интерфейсом управления контейнерами на хосте и добавляет возможность оркестрации контейнеров Docker на нескольких хостах. Red Hat OpenShift также использует поды Kubernetes. Под — это один или более контейнеров, развернутые на хосте. Под обеспечивает обмен данными между контейнерами. Каждый под имеет собственный IP адрес и собственное пространство портов. Контейнеры внутри подов могут совместно использовать локальное хранилище и сеть, поэтому контейнер может быть легче, чем виртуальная машина.

Сохраняйте работоспособность с помощью сервисов

Поды создаются и уничтожаются по мере масштабирования контейнеров в сторону увеличения или уменьшения. Так называемые “Сервисы” помогают предотвратить уничтожение подов, которые обеспечивают работоспособность других подов. Сервис определяется, как набор подов и используется для назначения политики доступа к подам (обычно это микросервис). Red Hat OpenShift использует сервисы для разделения подов, обеспечивающих работоспособность, от подов, которые больше не нужны, так что вам не нужно вручную отслеживать, какой из них к какой категории относится в постоянно меняющейся среде.

Приложения, работающие везде

Сосредоточьтесь на написании программ и оставьте платформе Red Hat OpenShift заботы по созданию, запуску и масштабированию ваших приложений в облачной и локальной инфраструктуре. Перемещайте приложения без сбоев независимо от того, где они запущены. Red Hat OpenShift выполняет эту задачу, рассматривая образ Docker как двоичный артефакт, который включает в себя весь стек приложения и его требования. Образ Docker создается как один из результатов каждой сборки и используется как универсальная развертываемая единица. Это означает, что с Red Hat OpenShift вам нужно сформировать только одну сборку, с которой затем вы можете развернуть приложение где угодно.

Контейнеры и поды

Контейнеры упаковывают и изолируют приложения таким образом, чтобы вы могли перемещать их между разными средами. Платформа Red Hat OpenShift оснащена интерфейсом управления контейнерами, а также возможностью оркестрации контейнеров Docker при установке на нескольких хостах.

Red Hat OpenShift использует поды Kubernetes. Под — это один или более контейнеров, развернутые на хосте. Под обеспечивает обмен данными между контейнерами. Каждый под имеет собственный IP адрес и собственное пространство портов. Контейнеры, содержащиеся внутри пода, могут иметь общий доступ к локальному хранилищу и сетевым службам.

Kubernetes

Red Hat OpenShift позволяет вам объединять группы хостов в кластеры и эффективно управлять этими кластерами. Кластеры могут охватывать хосты, расположенные в публичных, частных и гибридных облаках. Red Hat OpenShift является идеальной платформой для хостинга облачных cloud-native приложений, требующих максимально быстрого масштабирования.

Доверенный реестр контейнеров

Реестр Docker предоставляет надежный источник образов контейнеров. Red Hat OpenShift может создавать образы контейнеров на основе вашего исходного кода, развертывать их и управлять их жизненным циклом. Red Hat OpenShift предоставляет внутренний, интегрированный реестр Docker, который вы можете развернуть в своей среде для локального управления образами. Вы также можете установить реестр Red Hat OpenShift Container Platform в качестве изолированного реестра образов контейнеров.

Развертывание по разным инфраструктурам

Используйте Red Hat OpenShift для развертывания приложений в различных инфраструктурах или для перехода от существующего контейнерного образа к новому. Масштабируйте ваши приложения горизонтально, чтобы удовлетворять растущий спрос.

Каждый раз при развертывании создается новый контроллер репликации, который запускает поды. Контроллер репликации гарантирует постоянную работоспособность определенного количества реплик. Deployer-поды управляют развертыванием. При замене развернутой системы, предыдущий контроллер репликации сохраняется, чтобы при необходимости можно было легко откатиться к прошлой конфигурации.

Openshift — красношляпые поделки

OpenShift

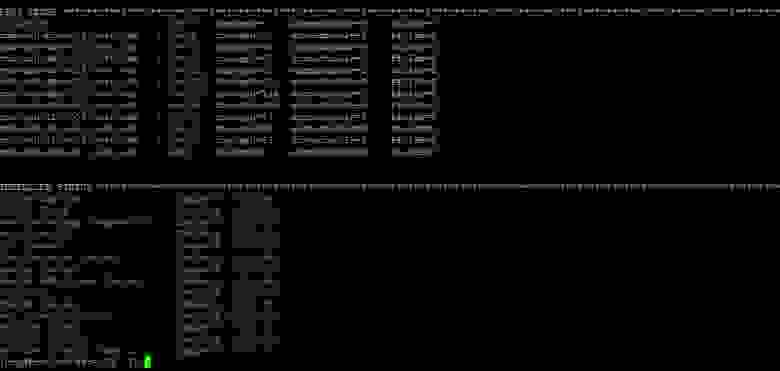

1. Развертка Openshift

Требования к серверам, подготовка dns серверов, список имен серверов, требования к серверам.

Минимальные требования кратко — все сервера должны иметь минимум 16Gb Ram 2 ядра и минимум 100 гигабайт для нужд docker.

dns на базе Bind должен иметь следующую конфигурацию.

dkm — мастер, dk0 — исполняющие, ifr — инфраструктурные, bln — балансировщик, shd — nfs, dkr — управляющая нода с которой происходила конфигурация кластера, так же планировалась как отдельная нода под docker regestry.

После подключения подписки. Включение репозиториев и установка необходимых изначально пакетов.

Конфигурация хранилища докера (отдельным диском).

Установка остальных необходимых пакетов.

Создание, добавление пользователя, а также ключей.

В случае конфликта с уже используемыми подсетями — изменить адресацию по умолчанию внутри контейнеров.

Конфигурация network manager. (dns должен уметь froward во внешний мир)

Правка в случае необходимости имени машины на полное имя.

После выполненных действий перезагрузить сервера.

Подготовка управляющей ноды dkr

Отличие управляющей ноды от остальных — нет необходимости подключать docker на отдельный диск.

Также есть необходимость настройки ntp.

Также нужно добавить закрытый ключ пользователю ocp.

Зайти по ssh под пользователем ocp на все ноды.

Подготовка Inventory file и развертка кластера.

Запуск поочередно плейбуков.

Если все хорошо в конце будет примерно следующие.

Правка локального файла хост для проверки после установки работу oprenshift по веб интерфейсу.

2. Конфигурация после установки

Проверить что есть возможность видеть в web интерфейсе скрытые ранее project (openshift, например).

3. Создание и подключение PV

Создание persistent volume на сервере nfs.

Добавление pv в openshift.

Необходимо создать проект oc new-project examplpv-project.

Если проект уже создан перейти в него oc project examplpv-project. Создать yaml следующего содержания.

созданный pv будет виден в списке.

4. Создание и разворачивание проекта Red Hat Decision Manager (enterprise аналог kie-workbench)

Проверить наличие шаблонов.

Добавление шаблонов — ссылку и более полное описание можно найти

Создадим новый проект:

Добавление авторизации на сервер docker registry.redhat.io:

Импорт imagetream, создание ключей Decision Server, Decision Central.

Создание persistent volume на сервере nfs.

Добавить pv в проект:

Приложение автоматически развернется по завершению Pull образов в docker-registry.

До этого момента статус будет таким.

В случае перехода по ссылке на образ будет следующая ошибка

Необходимо изменить url загрузки образов выбрав edit yaml с registry.redhat.io на registry.access.redhat.com

Для перехода в развернутый сервис в его web интерфейс необходимо добавить в файл hosts следующие url

на на любую из infra nodes

10.19.86.25 rnd-osh-ifr-t02.test.osh myapp-rhdmcentr-rhdm72.apps.openshift.test.osh

5. Создание и разворачивание проектов AMQ (red hat active mq) и postgressql c использованием персистентных хранилищ

Создадим новый проект

Импортируем образы в случае их отсутствия.

Добавление роли сервис аккаунту.

Создание pv на сервере nfs

Создаем из шаблона

Создаем еще один PV аналогично тому как делали для MQ.

Заполняем необходимые параметры

6. Создание отдельных проектов для сервисов, шаблонов к ним, pipeline, интеграция с gitlab, gitlab regestry

Первый делом необходимо создать проект.

Первично не имея шаблона можно создать в ручную приложение.

Есть два способа.

Первый просто используя готовый образ, но тогда не будет доступна версионность образов и т.д., но в некоторых случаях будет актуально.

Прежде всего, нужно получить данные для аутентификации к registry. На примере собранного образа в Gitlab это делается вот так.

Для начала надо создать секреты по доступу к docker registry — посмотреть варианты и синтаксис.

Затем создадим секрет

Затем создадим наше приложение.

Если что-то пошло не так, и образ не тянется в свойставх приложения указать секрет к нашему regestry.

Затем добавляем необходимые переменные окружения.

Готово — контейнер живой.

Затем нажмем справа edit yaml и укажем порты.

Затем чтобы получить доступ к нашему контейнеру необходимо создать route, но создать его без сервиса невозможно, потому первым делом необходимо создать сервис.

прописываем url в hosts на своей машине смотрящим на одну из infra nodes.

прописываем url в hosts на своей машине смотрящим на одну из infra nodes.

Шаблон создается методом выгрузки в yaml по отдельности всех компонентов которые относятся к сервису.

А именно в данном случае это secrets dc Service Route.

Посмотреть все что сделано в конкретном проекте можно

Затем можно взять за основу любой шаблон для opensihft и интегрировать то что было получено для получения шаблона.

В данном случае результат будет выглядеть так:

Можно добавить сюда и secret-ы, в следующем примере рассмотрим вариант сервиса со сборкой на стороне openshift где secret-ы будут в шаблоне.

Создание проекта с полными стадиями сборки образов, простому pipeline и сборкой по Push.

Первым делом создадим новый проект.

Для начала нужно создать Buildconfig из гита (в данном случае в проекте есть три докер файла, обычный докер файл который рассчитан на docker версии 1.17 выше используя два FROM, и два отдельных dockerfile для сборки базового образа и целевого.)

Для доступа в гит если он приватный нужна авторизация. Создадим secret со следующим содержанием.

Дадим сервис аккаунту builder доступ к нашему секрету

Привяжем секрет к url git

На выходе можно получить два вот таких шаблона.

Также нам понадобится создать deploymentconfig два imagestream и для завершения развертки service и route.

Я предпочел не плодить отдельно все конфиги, а сразу делать шаблон, включающий все компоненты для сервиса. за основу взяв предыдущий шаблон для варианта без сборки.

Использовать данный шаблон для развертки можно так

Затем создадим Pipeline

После применения конфигурации Pipeline, запустив

Можно получить url для webhook в gitlab.

Секрет заменить на указанный секрет в конфиге.

Так же после применения Pipeline openshift сам начнет установку jenkins в проекте для запуска Pipeline. Первичный запуск длительный, так что необходимо подождать некоторое время.

Затем в Gitlab в нашем проекте:

Заполнить Url, secret, убрать Enable SSL verificationю И наш webhook готов.

Можно сделать тестовый push и посмотреть на ход ведения сборки

Не забудьте прописывать в host url чтобы попасть в тот же jenkins на infranode.

Так же можно посмотреть ход сборки.

P.S. Надеюсь данная статья поможет многим понять как и с чем едят openshift, разяснит многие не очевидные с первого взгляда моменты.

P.S.S. некоторые решения для решения некоторых проблем

Проблемы с запуском билда сборки и т.д.

— создать сервис аккаунт для проекта

Проблемы с подвисом проекта и не удалением его

— скрипт принудительного завершения (болезнь врожденная)

Проблемы с загрузкой образов.

Также переопределить разрешения на папку для registry на nfs. (в логах registry ошибки на запись, билд же висит на пуше).

Red Hat OpenShift on IBM Cloud

Развертывайте полностью управляемые кластеры с высоким уровнем доступности всего одним нажатием кнопки

Обзор

Ведущая платформа для разработчиков

Red Hat OpenShift on IBM Cloud позволяет разработчикам OpenShift быстро и безопасно разместить в контейнерах и развернуть корпоративные приложения в кластерах Kubernetes. Кластеры OpenShift опираются на оркестрацию контейнеров Kubernetes, обеспечивающую гибкость и универсальность. Передав IBM управление контейнерной платформой OpenShift (OCP), вы сможете сконцентрироваться на своих ключевых задачах.

Гибкое развертывание высокомасштабируемых приложений в производственной среде с помощью Kubernetes (01:48)

Возможности

Оптимизация DevOps в гибридных, мультиоблачных, локальных и периферийных средах

Поддержка интерфейса Kubernetes

Используйте единый, согласованный интерфейс с уже знакомыми вам инструментами OpenShift и API, даже при работе в гибридных средах или с разными поставщиками облачных услуг.

Повышенная безопасность кластера и приложений

Обеспечьте защиту инфраструктуры кластера, изоляцию вычислительных ресурсов, шифрование данных и выполнение нормативных требований к безопасности при развертывании контейнеров с помощью IBM Cloud с высоким уровнем безопасности. Содержит строгие ограничения контекста безопасности для дополнительной защиты подов по умолчанию.

Постоянная доступность в глобальном масштабе

Обеспечьте глобальное развертывание и масштабирование приложений во всех многозонных регионах IBM Cloud. В состав кластеров OpenShift входит управляемый основной узел, который автоматически распределяется по зонам региона для обеспечения высокой доступности.

Интегрированный каталог OpenShift

Быстро настройте конвейер CI/CD в Jenkins или разверните разнообразные приложения с помощью пошагового интерфейса, полностью интегрированного в кластер OpenShift.

Все возможности платформы IBM Cloud для инноваций

Интегрируйте ИИ с помощью API Watson, чтобы расширить возможности ваших приложений. Получите доступ к промежуточному ПО IBM в IBM Cloud Paks на базе масштабируемого публичного облака. Воспользуйтесь встроенными службами мониторинга, регистрации, распределения нагрузки, хранения и защиты для управления жизненным циклом приложения.

Учебники

Создание кластера OpenShift

Создание кластера OpenShift

Создание стандартного кластера, открытие консоли OpenShift и доступ ко встроенным компонентам. Развертывание приложения со службами IBM Cloud в проекте OpenShift и открытие приложения для маршрутизации OpenShift, чтобы сделать его доступным для внешних пользователей.

Развертывание масштабируемых веб-приложений

Развертывание масштабируемых веб-приложений

Создание веб-приложения, локальное развертывание его в контейнере, выгрузка кода в частное хранилище Git и развертывание приложения в кластере. Предоставление и масштабирование приложения, привязка пользовательского домена и отслеживание среды.

Обновление сертификатов защиты

Обновление сертификатов защиты

Из этого учебника вы узнаете, как автоматизировать продление сертификатов Secure Sockets Layer (SSL) или Transport Layer Security (TLS) с помощью корпоративной среды Kubernetes OpenShift или бессерверного подхода.

Развертывание базы данных

Развертывание базы данных PostgreSQL

Этот учебник описывает процесс развертывания оператора, поставляемого сообществом, в действующем проекте Red Hat OpenShift с целью создания экземпляров базы данных PostgreSQL.

Автоматизация развертывания приложения

Автоматизация развертывания приложения

В этом примере кода показано, как с помощью Tekton сократить время развертывания приложения с 45 минут, в течение которых требуется непрерывно щелкать мышью и что-то настраивать, до 15 минут, в течение которых достаточно запустить несколько команд.

Примеры использования

The Masters

Повышение мастерства игры в гольф благодаря гибридному мультиоблаку

The Weather Company®

Миграция самого популярного в мире веб-сайта о погоде

Circeo

Многонациональное кредитование как услуга ежедневно набирает популярность

Лондонский университет искусств

Цифровая демонстрация работ студентов во время глобальной пандемии

Часто задаваемые вопросы

Какие версии OpenShift поддерживаются?

Red Hat OpenShift on IBM Cloud поддерживает следующие версии OpenShift. Операционная система рабочего узла: Red Hat Enterprise Linux® 7.

Устаревшие и неподдерживаемые версии:

Как установить CLI OpenShift в IBM Cloud?

Для создания и администрирования инфраструктуры кластера OpenShift, например создания кластеров и рабочих узлов, можно воспользоваться модулем интерфейса командной строки (CLI) для Red Hat OpenShift on IBM Cloud (ibmcloud oc). Затем с помощью CLI OpenShift (oc) можно управлять ресурсами кластера OpenShift, включая проекты, поды и развернутые экземпляры.

Как настроить маршруты OpenShift в IBM Cloud?

Предоставьте доступ к услугам в кластере Red Hat OpenShift on IBM Cloud, используя внешний IP-адрес маршрутизатора. По умолчанию маршрутизатор OpenShift развертывается в кластере, который выполняет роль конечной точки передачи данных для внешнего сетевого трафика.

С помощью маршрутизатора OpenShift можно создавать маршруты для приложений. Маршрутам присваивается публичное или частное имя хоста, относящееся к субдомену маршрутизатора, с помощью которого внешние клиенты могут отправлять запросы приложению. Можно создавать незащищенные или защищенные маршруты (с помощью сертификата TLS маршрутизатора для защиты имени хоста). При получении внешнего запроса маршрутизатор перенаправляет его на частный IP-адрес, который отслеживается приложением.

Входит ли реестр контейнеров в состав Red Hat OpenShift on IBM Cloud?

В состав кластеров Red Hat OpenShift on IBM Cloud входит внутренний реестр, обеспечивающий создание и развертывание образов контейнеров, а также управление ими локально. Для использования частного реестра с целью управления и контроля доступа к образам в масштабе организации можно также настроить IBM Cloud® Container Registry.

Доступны ли дополнительные меры безопасности в Red Hat OpenShift on IBM Cloud?

Red Hat OpenShift on IBM Cloud предоставляет встроенные функции защиты для анализа рисков и обеспечения безопасности. Эти функции помогают защитить инфраструктуру кластера и сетевые соединения, изолировать вычислительные ресурсы и выполнить нормативные требования к безопасности при развертывании компонентов инфраструктуры и контейнеров.

Как установить Red Hat OpenShift Service Mesh вместе с микросервисами в кластере Red Hat OpenShift on IBM Cloud?

Следуйте инструкциям, приведенным в этом учебном пособии, чтобы установить оператор Red Hat OpenShift Service Mesh (наряду с другими дополнительными операторами), настроить шлюз передачи данных Istio для предоставления доступа к услуге за пределами сервисной сетки, обеспечить управление трафиком для настройки таких важных задач, как A/B-тестирование и развертывание методом Canary, защитить обмен данными с микросервисами, а также применить метрики, протоколы и трассировку для анализа работы.