Как подключить к компьютеру три монитора или больше

Содержание

Содержание

Многомониторные конфигурации системы, считавшиеся когда-то чем-то запредельно фантастическим, сегодня становятся все более актуальными. В работе и учебе несколько мониторов обеспечивают многозадачность, позволяя с комфортом работать в нескольких приложениях одновременно. В играх дополнительные мониторы расширяют обзор и способствуют более глубокому погружению в игровой процесс. Если подключение пары мониторов редко связано с какими-либо трудностями (кроме подбора разъема), то организация системы из трех и более дисплеев часто вызывает всевозможные проблемы.

Какое оборудование нужно: какие видеокарты поддерживают

Пожалуй, самая распространенная ошибка — считать, что адаптер поддерживает подключение стольких мониторов, сколько разъемов на нем есть.

Даже на простеньких офисных моделях и игровых видеокартах начального уровня можно увидеть, например, четыре разъема для мониторов. Если задействовать их всех и попробовать включить ПК, то часть мониторов просто не будет работать. В чем проблема?

Чтобы избежать подобной ситуации, во-первых, нужно изучить описание продукта, обратив внимание на количество поддерживаемых мониторов. Количество одновременно работающих дисплеев может быть меньше количества доступных интерфейсов.

Далее стоит изучить характеристики мониторов:

Что же касается характеристик видеокарт, то стоит обратить внимание на такие параметры.

В целом, подключение трех мониторов поддерживают все модели NVidia серии 600 и выше, а также видеокарты AMD, начиная с 5-й серии. Разумеется, при наличии соответствующего количества разъемов. В большинстве карт AMD при многомониторных подключениях обязательно нужно задействовать порт DisplayPort.

Забывать о производительности других комплектующих тоже не стоит. Например, использование многомониторной конфигурации вместо одного дисплея повышает эффективность труда до 60 %, но при этом возрастает количество открытых окон и приложений. Это значит, что для комфортной работы нужен более мощный процессор, больше ОЗУ. Разумеется, все это приводит к увеличению потребляемой энергии, а значит — возникает необходимость в приобретении мощного и надежного блока питания. Большинство адаптеров с поддержкой трех и более мониторов оснащены разъемом для дополнительного питания. Кстати, к одной видеокарте рекомендуется подключать не более 2-3 монитора (в зависимости от производительности), если речь идет не о специализированных решениях.

Профессиональные видеокарты

В отличие от обычных пользовательских и игровых видеоадаптеров, это узконаправленное решение, которое предназначено для работы с графическими приложениями, требующими большой вычислительной мощи. Например, графические ускорители для обработки видео. Помимо прочего, среди профессиональных видеокарт присутствуют модели для создания видеостен. Так Matrox C680 может выдать разрешение 4096×2160 пикселей на 6 мониторов. В этом случае не стоит рассчитывать на высокую производительность в играх. Преимуществом таких решений является компактность, экономное энергопотребление, низкий уровень шума и простота организации охлаждения. Иными словами, проблем со сборкой системы из нескольких видеокарт в этом случае не предвидится. Раскрыть потенциал профессиональной видеокарты поможет ПО.

Поддерживают ли встроенные видеокарты три и более монитора

Современные интегрированные видеокарты на базе процессоров Intel и AMD могут обслужить не более трех мониторов. Если «синяя команда» выложила информацию по этой теме с подробным описанием возможных конфигураций, то AMD открыто не публикует данные, поэтому приходится доверять обзорщикам и тестировщикам.

Возможности встроенной графики процессора Intel Core i9-10900K представлены на скриншоте ниже, а ссылка на поддерживаемые конфигурации с тремя дисплеями и интегрированной графикой Intel здесь.

Что делать, если нужно подключить больше мониторов, чем поддерживает видеокарта

Выбор дополнительной аппаратуры зависит от целей создания мультимониторной системы, что определяет итоговую стоимость реализации. Какие варианты существуют?

Как видите, есть решения на все случаи жизни, включая варианты для ПК и ноутбука.

Системы с двумя и более видеокартами

Самый распространенный и рациональный вариант при создании мультимониторных систем для работы, учебы, игр и стриминга. На современных материнских платах может быть несколько слотов под видеокарты, например, в модели для рабочих станций GIGABYTE X299-WU8 предложено семь разъемов PCI-E x16, но обязательно нужно изучить схему их работы в описании продукта. Для производительных систем рекомендуются схемы с разрядностью от x8 и выше.

Практически все игровые адаптеры имеют массивную систему охлаждения, поэтому могут мешать установке друг друга. Кроме того, между адаптерами должно быть свободное пространство. При нехватке места для установки можно прибегнуть к подключению через райзер.

Существует несколько распространенных конфигураций взаимодействия двух и более видеокарт.

При использовании технологии CrossFire/SLI лучше устанавливать идентичные адаптеры: система подстроится под слабейшую карту, а объем видеопамяти не суммируется.

Карты AMD

Совместная работа нескольких адаптеров возможна при условии совпадения их серии. Для объединения используется мультипроцессорная конфигурация CrossFire, а ее поддержка указана в описании продукта. Это решение направлено на улучшение производительности, а в играх с поддержкой технологии можно получить прирост FPS.

Для создания мультимониторной системы с единым визуальным пространством используют технологию AMD Eyefinity. Функция объединяет подключенные к видеокарте мониторы в один с более высоким разрешением. В зависимости от модели адаптера, можно установить до шести дисплеев через порты DisplayPort. Технология может работать и с интегрированной графикой.

Инструкция по настройке AMD Eyefinity.

Карты NVidia

В этом случае нужно ставить одинаковую модель адаптера, но без привязки к производителю. У компании есть альтернатива для взаимодействия нескольких видеокарт под названием NVidia SLI. Если CrossFire AMD поддерживается практически на всех материнских платах с несколькими слотами PCI-E, а настройка осуществляется автоматически, то для использования технологии «зеленой команды» требуется покупка лицензии у NVidia, поэтому присутствует на более дорогих платах. Сама настройка немного сложнее и осуществляется вручную.

Для создания многомониторной конфигурации тоже предложено свое решение — NVidia Surround / 3D Vision. В этом случае привязка к используемому типу подключения отсутствует, но для объединения используется только три экрана.

Наглядную видеоинструкцию по активации технологии NVidia Surround можно посмотреть в следующем ролике.

Альтернативные решения

Перечисленный варианты подходят для игровых систем, но не всегда есть необходимость в создании единого визуального пространства. Так можно обойтись без SLI / CrossFire и даже использовать видеокарты AMD и NVidia в одном компьютере. Как уже говорилось, в этом случае видеокарты работают раздельно, что тоже имеет право на жизнь. Мощности одного адаптера можно использовать для игр, а второй карте назначить другие задачи, например, стриминг.

Точная настройка работы мониторов и адаптеров осуществляется через ПО: панель управления NVIDIA или AMD Catalyst. Для упрощенной настройки режимов отображения мониторов можно воспользоваться средствами Windows, как это показано в короткой инструкции от Microsoft в видео ниже.

Есть еще один интересный вариант — использование дискретной и интегрированной графики. В этом случае нужно активировать работу интегрированной графики в БИОСе, включив PCI/iGPU и режим Multi-monitor. Разумеется, в этом случае тоже возможна только раздельная работа видеокарт.

Многомониторная конфигурация может включать не только компьютерные мониторы, но и устройства на Android и iOS. Например, это может пригодиться в подключении панели для рисования. Для этого существуют соответствующие приложения: Splashtop Wired XDisplay Free, iDisplay и их аналоги. Большинство из них, увы, платные.

Как лучше разместить три и более монитора

Почерпнуть идеи расположения трех мониторов в пространстве можно в этой статье. При выборе схемы расположения нужно опираться на свои потребности и цели. Для реализации задуманного не обязательно самостоятельно создавать подходящий стенд и рабочий стол.

Помимо подставок в комплекте к монитору, можно использовать потолочные, настенные и настольные кронштейны, платформы, а также всевозможные стойки с напольной установкой. Для этого используются универсальные крепления VESA, реже — нестандартные решения от производителей мониторов. Если в системе планируется использовать дисплей с большой диагональю, то стоит ознакомиться с особенностями монтажа больших мониторов, о чем подробнее говорилось здесь.

И напоследок несколько идей организации рабочего или игрового места с большим количеством экранов.

Здравствуйте админ, такой вопрос. Как включить встроенную видеокарту при наличии в системном блоке мощной дескретной (ставящейся отдельно). Я просто хочу проверить, на всякий случай, работает встроенная или нет. Короче расскажу всю свою историю.

Купил новый системный блок, в материнской плате ASUS есть встроенная видеокарта, но я ни разу не подключал к ней монитор, так как есть ещё и мощная дискретная видеокарта NVIDIA GeForce, которую я использую постоянно. И вот в определённый момент, изображение на мониторе пошло полосами и стало периодически пропадать, я решил проверить, работает ли у меня встроенная в материнскую плату видеокарта. На выключенном компьютере отсоединяю кабель DVI от дискретной видеокарты и подсоединяю к встроенной, затем включаю компьютер и на мониторе ничего нет, просто чёрный экран, а системный блок в это время работает. В результате этого я пришёл к выводу, что мало того, что дискретная видеокарта бракованная, так и встроенная в материнку тоже не работает. Прав я или нет?

Как включить встроенную видеокарту

Войти в расширенный режим. ОК. Можете выбрать Язык системы Русский.

И всё в вашем БИОС UEFI будет на русском, но так мало кто работает, учитесь работать в английском интерфейсе. Сначала я покажу как сделать всё на русском, а затем на английском.

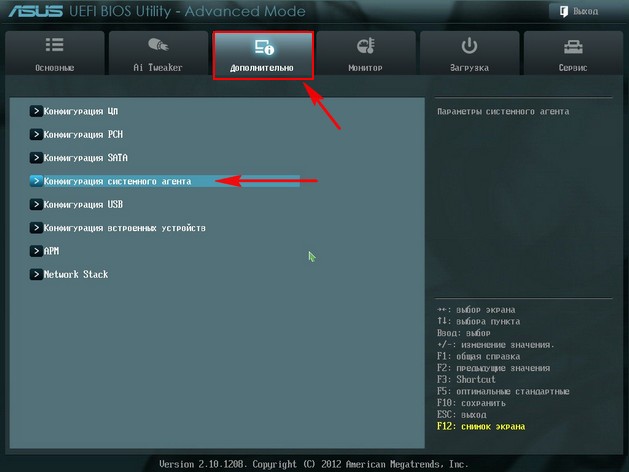

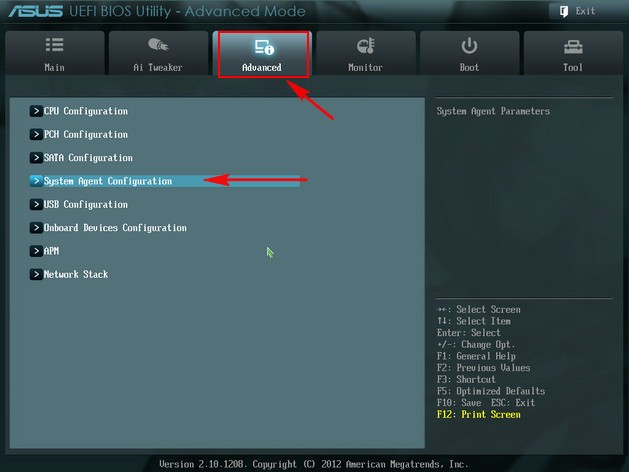

Вкладка Дополнительно. Конфигурация системного агента.

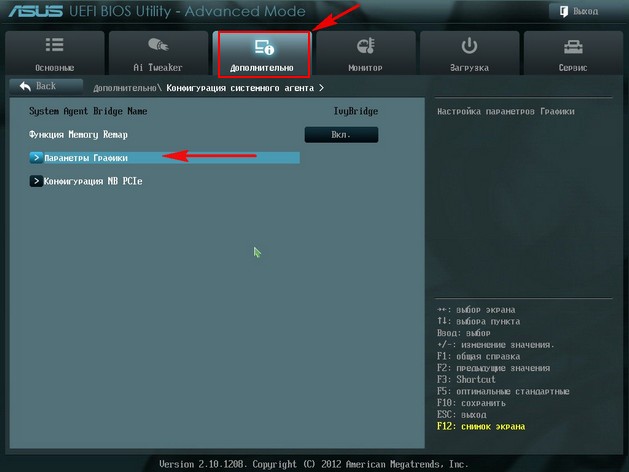

Опцию Основной дисплей выставляем в положение iGPU – интегрированная графика.

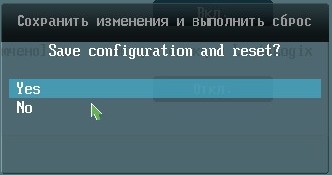

Для сохранения внесённых нами в БИОС изменений жмём на клавишу F10,

затем Yes и перезагружаемся.

Выключайте компьютер, соединяйте кабелем DVI или VGA вашу встроенную видеокарту и монитор, затем включайте компьютер. И устанавливайте драйвера на подключенную встроенную видеокарту.

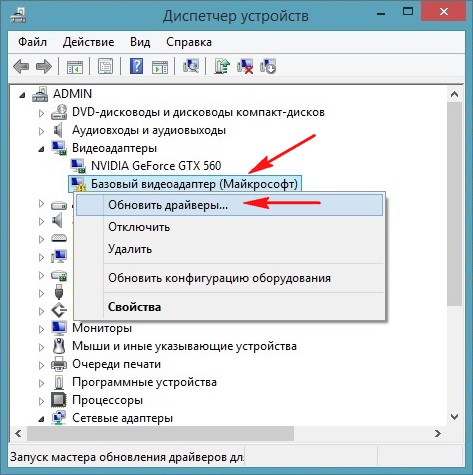

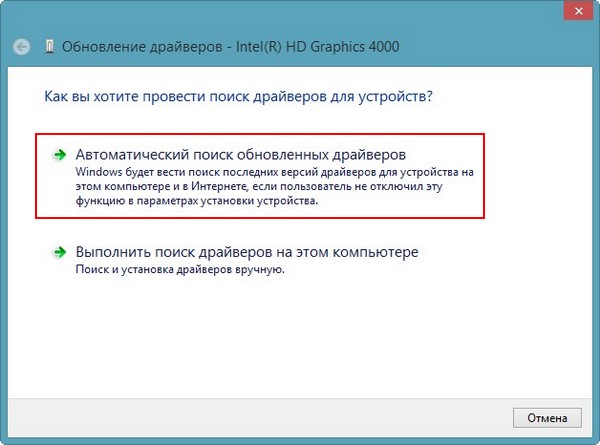

Идём в диспетчер устройств, щёлкаем правой мышью на встроенном видеоадаптере и выбираем в меню Обновить драйверы.

Автоматический поиск обновленных драйверов. Если драйвер автоматически не установится, значит скачиваем драйвер на встроенную видеокарту на официальном сайте нашей материнской платы.

Опцию Primary Display выставляем в параметр iGPU – интегрированная графика,

Выключаем компьютер, соединяем кабелем DVI или VGA вашу встроенную видеокарту и монитор, включаем компьютер, устанавливаем драйвера.

Igd multi monitor что это

Опция BIOS Init Display First

Опция Graphic Adapter Priority предназначена для выбора графической видео карты (соответствующего ей выхода на монитор), который будет использоваться в качестве системного — действующего и на которой будет идти информация о загрузке компьютера. Обычно опция очень актуальна в случае наличия встроенной видео карты на материнской плате и внешней — как правило в сотни раз более высокопроизводительной — подключаемой через шину на плате AGP или PCI-E.

Часто при обнулении БИОС или сбросе на дэфаул — и последующей при перезагрузке не показывает монитор — первое что следует сделать — это проверить данную опцию — к тому ли разъему — той ли видео карты подключен в данный момент монитор!

Возможные значения опции:

Опция также может иметь другие названия:

Примечание 1. PCI Express. В отличие от стандарта PCI, использовавшего для передачи данных общую шину с подключением параллельно нескольких устройств, PCI Express, в общем случае, является пакетной сетью с топологией типа звезда. Высокая пиковая производительность шины PCI Express позволяет использовать её вместо шин AGP и тем более PCI и PCI-X. Де-факто PCI Express заменила эти шины в персональных компьютерах.

Примечание 2: AGP (от англ. Accelerated Graphics Port, ускоренный графический порт) — специализированная 32-разрядная системная шина для видеокарты, разработанная в 1996 году компанией Intel. В данный момент материнские платы со слотами AGP практически не выпускаются; стандарт AGP был повсеместно вытеснен на рынке более быстрым и универсальным PCI Express Последними серийно выпускавшимися видеокартами для шины AGP были GeForce 7950GT (nVidia) и Radeon HD4670 (AMD).

Программа Setup BIOS фирмы AWARD Software International Inc на системных платах GIGABYTE TECHNOLOGY

Название данной опции у данного производителя в данной версии BIOS:

Что делает iGPU Multi-Monitor?

недавно я собрал новый компьютер и заинтересовался идеей использования интегрированной графики, чтобы, возможно, снять часть нагрузки с видеокарты, управляя моим вторым экраном; или что-то в этом роде.

Я искал в BIOS, и сначала замечено, что не было настройки для включения как видеокарты PCIe, так и встроенной. Но есть настройка с надписью «IGPU Multi-Monitor», и я не уверен, что это делает. Нет реального описания того, для чего предназначена эта настройка. Основываясь на его имени, это может быть просто настройка, позволяющая двум мониторам запускать IGPU в одиночку.

Что делает установка IGPU Multi-Monitor? Каковы его преимущества/недостатки?

Форум Emu-Land.net

Автор Тема: Как отключить встроенную в процессор видеокарту (Прочитано 2158 раз)

Автор Тема: Как отключить встроенную в процессор видеокарту (Прочитано 2158 раз)

0 Пользователей и 1 Гость просматривают эту тему.

Как правильно установить дискретную видеокарту?

Как установить дискретную видеокарту по умолчанию

Здравствуйте! Ноутбук ASUS x75vc. В свойстве адаптера отображается интегрированная видеокарта.

Как задействовать дискретную видеокарту?

Доброго времени суток. Стоит на ноутбуке дискретная видеокарта Radeon R7 m360. но ни одна игра.

Проблема такого рода, переустанлновил виндовс и мою GTX 660 в диспетчере устройств определяет как.

Подключил внешнею видеокарту к ноуту (Как отключить дискретную?)

Здравствуйте всем. В общем подключил внешнею видеокарту к ноуту, переустановил драйвера. В.

Как выключить дискретную видеокарту. Мать ASRock D1800M

Здравствуйте! Поставил на мать ASRock D1800M видеокарту 9800 GT. Но хочу использовать встроенную в.

Выводим картинку через интегрированное видео.

Перейти к странице

BoostOrDie

Свой человек

Вообщем вчера мне подсказали как выводить картинку через видео крату встроенную в камень, чтобы не растрачивать ресурсы первой видео карты на это, я попробовал, пару раз споткнулся но все таки сделал это, и хочу мини гайдик для остальных сделать.

И так с чего нужно начать?

1) Отключаем все видео карты от матери и втыкаем монитор в материнку.

2) Заходим в Биос и ищем там настройку инициализации графических адаптеров. Это будет что-то типа Integrated graphics settings.

3) Там будут значения PEG или IGD. Выбираем IGD.

4) Сохраняем настройки и перезагружаемся снова в БИОС.

5) Теперь там где мы выбрали IGD скорей всего будет доступен выбор размер, а видео памяти для интегрированной карты. По умолчанию всегда 64мб. Я рекомендую выставить от 256мб. ( я выставил 512, все таки 2017 год на дворе). Учтите, что эта память будет «откусываться» от оперативной.

6) Далее ищем настройки PCI configuration.

Там скорей всего ( если у вас материнка не из говна и палок, то есть современная) будет настройка Enable above 4G memory или decoding. «4G что то там» короче, ставим как Disabled. Сохраняемся выходим и ставим новую ОС.

7) После установки новой ОС, ставим все драйвера Кроме NVIDIA и РАДЕОН дров.

9) Ставим дрова на первую карту. Перезагружаемся — проверяем что с одно картой картинка по прежнему передается через мать и что драйвера встали корректно.

10) Выключаем комп, подключаем вторую карту. Тут есть важный момент.

У меня 4 порта x16 + x1 +x1 +x16. Я столкнулся с тем, что если воткнуть две карты в x16 сразу, то система не загружается — у меня черный экран с мигающим курсоров в углу. Как я это испраил — читаем далее.

И так. Нужно соблюдать порядок подключения.

-Сначала одна карта в первый x16

— Потом по одной карте в каждый x1 слот (1 включили, дрова поставили, проверили, повторяем со следующей)

Когда у нас остается для подключение порт x16 (второй или третий) нужно зайти в биос и найти ту настройку «4G что то там». (кстати после обновления биоса до последнего у меня в названии этой настройки появилось /mining crypto currency).

11) Включаем в Биосе 4G Decoding опцию. Сохраняемся, выключаем комп. Подключаем карту во второй слот x16. Грузимся в ОС, ставим дрова, ребутаемся, если картинка идет с матери, все ОК. Проверяем корректность дров. если у вас 3 слота x16 то вставляем туда карту и ставим дрова.

Поздравляю, теперь у вас вывод изображения на монитор или TW обрабатывается через встроенное в процессор графическое ядро. Ваша первая карта (куда у вас была затычка вставлена) не тратит 0.5-1.5 мх на обработку картинки рабочего стола.

PS у меня после этого всего перестала требоваться Затычка для первой карты. Карты запускаются без каких либо HDMI конвертеров.

В диспетчере устройств у вас должны быть ваши карты + Intel. Как я вчера выяснил он также отображается и в Afterburner. Но он не может разогнать intel и майнер не умеет работать с intel так что никаких проблем быть не должно.

Удачного майнинга. (PS может быть я перестраховываюсь и делаю много лишних шагов (например запуска карты по одной, вместо того чтоб сразу в x1 воткнуть разом). Напишите об этом, я тоже учусь пока майнингу. Возможно для кого-то это будет не интересно и банально, а кому то поможет.

Надеюсь будет полезно.

Свой человек

Друг форума

Вообщем вчера мне подсказали как выводить картинку через видео крату встроенную в камень, чтобы не растрачивать ресурсы первой видео карты на это, я попробовал, пару раз споткнулся но все таки сделал это, и хочу мини гайдик для остальных сделать.

И так с чего нужно начать?

1) Отключаем все видео карты от матери и втыкаем монитор в материнку.

2) Заходим в Биос и ищем там настройку инициализации графических адаптеров. Это будет что-то типа Integrated graphics settings.

3) Там будут значения PEG или IGD. Выбираем IGD.

4) Сохраняем настройки и перезагружаемся снова в БИОС.

5) Теперь там где мы выбрали IGD скорей всего будет доступен выбор размер, а видео памяти для интегрированной карты. По умолчанию всегда 64мб. Я рекомендую выставить от 256мб. ( я выставил 512, все таки 2017 год на дворе). Учтите, что эта память будет «откусываться» от оперативной.

6) Далее ищем настройки PCI configuration.

Там скорей всего ( если у вас материнка не из говна и палок, то есть современная) будет настройка Enable above 4G memory или decoding. «4G что то там» короче, ставим как Disabled. Сохраняемся выходим и ставим новую ОС.

7) После установки новой ОС, ставим все драйвера Кроме NVIDIA и РАДЕОН дров.

9) Ставим дрова на первую карту. Перезагружаемся — проверяем что с одно картой картинка по прежнему передается через мать и что драйвера встали корректно.

10) Выключаем комп, подключаем вторую карту. Тут есть важный момент.

У меня 4 порта x16 + x1 +x1 +x16. Я столкнулся с тем, что если воткнуть две карты в x16 сразу, то система не загружается — у меня черный экран с мигающим курсоров в углу. Как я это испраил — читаем далее.

И так. Нужно соблюдать порядок подключения.

-Сначала одна карта в первый x16

— Потом по одной карте в каждый x1 слот (1 включили, дрова поставили, проверили, повторяем со следующей)

Когда у нас остается для подключение порт x16 (второй или третий) нужно зайти в биос и найти ту настройку «4G что то там». (кстати после обновления биоса до последнего у меня в названии этой настройки появилось /mining crypto currency).

11) Включаем в Биосе 4G Decoding опцию. Сохраняемся, выключаем комп. Подключаем карту во второй слот x16. Грузимся в ОС, ставим дрова, ребутаемся, если картинка идет с матери, все ОК. Проверяем корректность дров. если у вас 3 слота x16 то вставляем туда карту и ставим дрова.

Поздравляю, теперь у вас вывод изображения на монитор или TW обрабатывается через встроенное в процессор графическое ядро. Ваша первая карта (куда у вас была затычка вставлена) не тратит 0.5-1.5 мх на обработку картинки рабочего стола.

PS у меня после этого всего перестала требоваться Затычка для первой карты. Карты запускаются без каких либо HDMI конвертеров.

В диспетчере устройств у вас должны быть ваши карты + Intel. Как я вчера выяснил он также отображается и в Afterburner. Но он не может разогнать intel и майнер не умеет работать с intel так что никаких проблем быть не должно.

Удачного майнинга. (PS может быть я перестраховываюсь и делаю много лишних шагов (например запуска карты по одной, вместо того чтоб сразу в x1 воткнуть разом). Напишите об этом, я тоже учусь пока майнингу. Возможно для кого-то это будет не интересно и банально, а кому то поможет.

Надеюсь будет полезно.